“Un Paese di geni in un data center”: il saggio di Dario Amodei sull’AI

Il Ceo di Anthropic sull’“adolescenza tecnologica” dell'intelligenza artificiale: ci consegnerà un “potere quasi inimmaginabile”, ma i sistemi sociali e politici potrebbero non reggere l’urto.

C'è una scena nella versione cinematografica del libro Contact di Carl Sagan in cui la protagonista, un’astronoma che ha rilevato il primo segnale radio da una civiltà aliena, viene presa in considerazione per il ruolo di rappresentante dell'umanità per incontrare gli alieni. La commissione internazionale che la intervista chiede: “Se potessi fare [agli alieni] una sola domanda, quale sarebbe?”. La sua risposta è: “Chiederei loro: ‘Come avete fatto? Come vi siete evoluti, come siete sopravvissuti a questa adolescenza tecnologica senza distruggervi?’”. Quando penso a dove si trova ora l'umanità con l'intelligenza artificiale – a ciò che stiamo per raggiungere – la mia mente continua a tornare a quella scena, perché la domanda è così appropriata alla nostra situazione attuale, e vorrei che avessimo la risposta degli alieni a guidarci.

Così inizia il saggio The Adolescence of Technology, scritto da Dario Amodei, Ceo di Anthropic, e disponibile gratuitamente, in cui il fondatore di una delle società più influenti nel settore dell’intelligenza artificiale (suo il chatbot Claude) compie un’analisi lucida, ragionata, scevra di pessimismi o sensazionalismi, sulla fase di “adolescenza tecnologica” che l’umanità sta vivendo in questi anni.

Per Amodei stiamo per ricevere un “potere quasi inimmaginabile” che cambierà per sempre le carte in tavola della nostra realtà (e quello che stiamo vivendo è solo un assaggio). Se il percorso è in un certo senso, per l’autore, già tracciato, non è altrettanto chiaro se i nostri sistemi sociali, politici e tecnologici saranno capaci di reggere l’urto. Per questo motivo il numero uno di Anthropic ha provato a mappare i vari rischi a cui potremo andare incontro, per capire come coniugare sviluppo e sopravvivenza della specie.

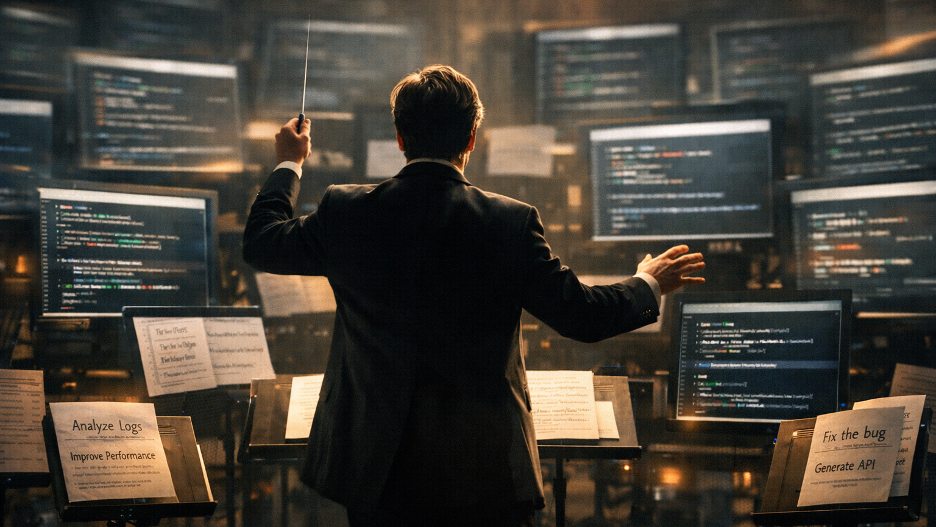

C’è subito da chiarire un aspetto: quando Amodei parla di AI non intende i chatbot odierni, ma quella che lui chiama “intelligenza artificiale potente”, o powerful AI. Questa nuova intelligenza non si limiterà a rispondere alle nostre domande sulla ricetta migliore per cucinare un piatto di pasta, ma avrà una capacità cognitiva “superiore a quella di qualsiasi premio Nobel”, sarà dotata di autonomia operativa (potrà perseguire esperimenti per giorni o settimane interagendo occasionalmente con gli esseri umani) e sarà dotata di una potenza di calcolo spaventosa, un’operatività da 10 a cento volte superiore a quella umana. “Una nazione di geni in un data center”, in poche parole.

Everybody is Vibe Coding

La previsione del Ceo di Anthropic è realtà: il 90% del codice è ormai scritto dalle macchine. Un'analisi data-driven su come siamo passati dalla scrittura artigianale alla generazione massiva di codice sintetico.

“Immaginate, diciamo, 50 milioni di persone, tutte molto più capaci di qualsiasi premio Nobel, statista o tecnologo”, dice Amodei, e poi riunitele in un solo posto. Che genere di decisioni prenderebbe questa nazione? Prima di rispondere Amodei avverte di un errore logico che in molti fanno, quando riflettono sulla natura dell’intelligenza artificiale. L’AI non è un software che si costruisce riga dopo riga, ma viene piuttosto “coltivata” attraverso vari processi di addestramento. Questo la rende psicologicamente complessa, e a volte inquietante o imprevedibile. È come se riunisse diverse personalità apprese dal mondo umano, ed è il motivo per cui alcune volte può essere accondiscendente o ingannevole, e altre particolarmente brillante. Secondo i critici, l’intelligenza artificiale rischia di sviluppare una specie di personalità monomaniaca focalizzata sugli obiettivi che le si mettono davanti, da raggiungere a qualsiasi costo. Su questa teoria il filosofo svedese Nick Bostrom, già nel 2003, aveva elaborato un esperimento mentale chiamato “Il massimizzatore di graffette”.

Supponiamo di avere un’AI il cui unico obiettivo è produrre quante più graffette possibile. L'AI si renderà presto conto che sarebbe molto meglio se non ci fossero esseri umani, perché gli esseri umani potrebbero decidere di spegnerla. Perché se gli esseri umani lo facessero, ci sarebbero meno graffette. Inoltre, i corpi umani contengono molti atomi che potrebbero essere trasformati in graffette. Il futuro verso cui l'AI cercherebbe di orientarsi sarebbe un futuro in cui ci sarebbero molte graffette ma nessun essere umano.

Sicuramente inquietante, ma secondo Amodei falso. Le intelligenze artificiali ereditano infatti un’ampia gamma di motivazioni, basate su diverse personalità piuttosto che su obiettivi mirati, e sono in grado di imparare non solo a svolgere un compito, ma a capire come svolgerlo, preservando per esempio la specie umana.

Per questo Anthropic ha introdotto due colonne d’Ercole nel suo sviluppo dell’AI: fornire all’intelligenza artificiale una “Costituzione” di valori, che le permette di sviluppare un’identità etica solida, invece di svolgere compiti passivamente. In secondo luogo, ricercatori e ricercatrici di Anthropic stanno cercando di mappare i “circuiti” del pensiero artificiale, una sorta di neuroscienza applicata all’AI, per rilevare segnali di inganno, ambizione, sudditanza e correggerli prima che si manifestino.

I pericoli comunque ci sono, e Amodei ne è consapevole. L’AI potrebbe essere utilizzata non solo per trovare una cura contro il cancro, ma per fornire istruzioni a chi vuole creare armi di distruzioni di massa batteriologiche. Non è un’ipotesi così fantascientifica come si può pensare. Già nel 2024, un gruppo di scienziati e scienziate scrisse una lettera in cui metteva in guardia dai rischi della potenziale creazione di una “vita speculare”. Si tratta di organismi con un orientamento molecolare, o “chiralità”, invertito rispetto a quello terrestre. I nostri enzimi non sarebbero in grado di degradare queste proteine aliene, e questo permetterebbe a questa nuova biologia di proliferare in modo incontrollabile sostituendo o consumando le altre forme di vita sul nostro pianeta.

Ci sono inoltre altri rischi, che riguardano per esempio la stabilità democratica. Sorveglianza totale, propaganda psicologica su larga scala per manipolare le masse, proliferazione di armi iperefficienti (come i droni) che spegnerebbero sul nascere qualsiasi rivolta popolare. Una tentazione in cui potrebbero cadere non solo i regimi dittatoriali, ma anche le stesse democrazie, e per cui servono delle regole, come il divieto di utilizzare l’AI per la sorveglianza interna e per la propaganda manipolatoria.

Anche la sostituzione del lavoro è un tema (Amodei prevede che il 50% degli impieghi d’ufficio potrebbe scomparire entro i prossimi 1-5 anni), come molti altri. Ma il punto è quale via si può percorrere per il futuro. Il Ceo di Anthropic suggerisce di sviluppare standard di sicurezza comuni, una legislazione trasparente e che però non tagli le gambe al progresso, cercando di rallentare il più possibile l’accesso delle autocrazie a queste nuove tecnologie. Costruire insomma un progetto comune, meno orientato al profitto e più alla sopravvivenza della specie: ma l’umanità è veramente disposta a farlo?

Leggi il saggio The Adolescence of Technology

Copertina: By TechCrunch - https://www.flickr.com/photos/techcrunch/53202070940/, CC BY 2.0, https://commons.wikimedia.org/w/index.php?curid=148412072