Il 5G è (quasi) tra noi, ma già si pensa al 6G - Parte I

Il primo di due articoli a scopo divulgativo su miti, realtà ed estrema rilevanza delle tecnologie di nuova generazione, e la loro ineludibile interazione con la società, l'impresa, l'economia e i servizi. 15/02/21

di Fulvio Ananasso

1. Introduzione - Esplosione del traffico in rete

La velocità (bit al secondo, bps) sempre più alta richiesta dalla crescente popolarità di servizi su Internet Protocol (Ip) - video, comunicazioni “immersive” / realtà (aumentata e) virtuale, online gaming, file sharing, ecc. -, impone di realizzare reti di nuova generazione, sia fisse che mobili, sempre più veloci e performanti – ultrabroadband (Ubb) next generation access (Nga).

Un aspetto molto rilevante è rappresentato dalla costante decrescita dei servizi tradizionali di traffico voce / sms. Ciò è dovuto sia alla presenza di alternative equivalenti su reti dati – servizi gratuiti voce su IP (VoIP, e.g. Skype) e messaggistica istantanea (Telegram,WhatsApp, etc.) -, sia alla sempre maggior rilevanza di comunicazioni basate sui social media -- Facebook, Twitter, ...

Secondo Cisco, il traffico dati globale ha superato lo ZettaByte (1021 Byte, 1 Byte = 8 bit) nel 2016, e passerà ogni mese dai 122 ExaByte (1018 Byte) del 2017 ai 396 ExaByte (~4,8 ZettaByte / anno) del 2022, con una crescita annuale (Cagr, compound annual growth rate) del 26,5%. Si pensi che nel 1992 le reti dati Ip trasportavano ~100 GigaByte (109 B) al giorno, 100 Gb al secondo nel 2002, oltre 28mila Gb / sec nel 2013 e oltre 50mila Gb / sec nel 2018.

La crescita impetuosa del traffico Ip richiede alle Telco (telecom company) di investire nelle citate infrastrutture Ubb, allo stesso tempo ricercando nuove fonti di ricavi / modelli di business. La diminuzione dei ricavi da traffico voce degli Operatori di Rete (Telco) non è infatti compensata adeguatamente dai ricavi dalla fornitura di servizi di accesso per traffico dati (IP).

Considerando l’aumento di traffico Ip dal 1983 al 2016, la larghezza di banda (velocità) offerta agli utenti obbedisce alla Legge di Nielsen, aumentando di circa il 50% all'anno – oltre il 10% in meno rispetto alla legge di Moore sulla capacità di calcolo, che raddoppia ogni 18 mesi. La velocità delle reti cresce pertanto più lentamente del potere computazionale del software, e rappresenta il fattore limitante (bottleneck) nella qualità di esperienza (QoE) d’uso di internet.

Va peraltro sottolineata la differenza tra velocità di trasmissione dati (bit rate) nell’accesso alle reti e velocità delle applicazioni (throughput), che può risultare anche significativamente inferiore alla bit rate. La bit rate è il parametro generalmente propagandato dai fornitori della connettività alla rete di accesso (Telco/internet service provider), mentre i fornitori di contenuti / applicazioni si concentrano (comprensibilmente) non tanto sulla bit rate quanto sul throughput e sul (correlato) tempo di download, parametro che influenza direttamente il tempo di permanenza degli utenti nei siti dei fornitori di contenuti -- e di conseguenza i loro ricavi.

Nel realizzare le reti Ubb, è pertanto estremamente rilevante il ritardo di trasmissione tra origine e destinazione (latenza), e in particolare del percorso completo dalla richiesta dell’utente (upload) alla risposta (download), il c.d. round trip time (= latenza x 2). Questo, insieme al packet loss - la eventuale perdita di pacchetti (con necessità di doverli ritrasmettere, rallentando la velocità complessiva) - limita il throughput e ha un impatto negativo sul download time.

Pertanto, aumentare solo la velocità di banda Ubb (bit rate), pur necessario, non è sufficiente ad incrementare proporzionalmente la velocità di download delle applicazioni (throughput) e di conseguenza la qualità di esperienza (QoE) / soddisfazione dell’utente, ma occorre allo stesso tempo ridurre latenza / packet loss. Questi sono alcuni degli elementi caratteristici del 5G.

2. 5G e generazioni precedenti

Le varie generazioni radiomobili si sono avvicendate sinora con cadenza sostanzialmente decennale: 1G (analogico) negli anni ‘80, 2G (Gsm) negli anni ‘90, 3G (Umts) intorno al 2000, 4G (Long Term Evolution, Lte) nel 2008÷2010 (V. Fig.1). Progressivamente la velocità di banda è aumentata, fino ai 100 Mbps nei sistemi LTE e 1÷3 Gbps in Lte Advanced (4G+, 4.5G), che rappresenta la transizione verso i sistemi 5G – lancio nei vari Paesi 2019÷2022.

A differenza però delle altre generazioni mobili, ognuna delle quali costituiva un miglioramento con superamento della precedente generazione, il 5G non solo sostituisce il 4G, ma lo valorizza e lo completa, sfruttando la convergenza tra servizi di rete fissa e mobile per ottimizzare tutta la rete (architettura orchestrata end-to-end), non solo quella cellulare. Questa è composta da:

- un sistema di accesso a radio frequenza (Rf), che assicura la connessione dei dispositivi mobili (ad es. il nostro smartphone) alla stazione radio base (i tralicci con le antenne);

- una sistema di rete fissa, che connette (in fibra ottica ma non solo) le stazioni radio base tra loro e con la rete di telecomunicazione / internet.

Le comunicazioni dai nostri dispositivi raggiungono attraverso la rete di accesso radio la stazione radio base più vicina (la “cella” radio dove siamo al momento), da cui vengono instradate verso i destinatari attraverso la rete fissa, per poter raggiungere sia postazioni fisse (abitazioni, uffici, …) che altri dispositivi mobili attraverso le stazioni radio base corrispondenti alle celle di destinazione.

Il sistema 5G non presenta tecnologie di accesso radio particolarmente innovative - a parte interfacce radio Mimo (Multiple Input Multiple Output) con capacità di beam forming per servire i singoli utenti -, mentre, attraverso la “softwarizzazione” delle funzioni di rete e la loro integrazione con il cloud, permette interessanti prestazioni di qualità del servizio (QoS), quali una elevata velocità (fino a 10 Gbit/s) e un ridotto ritardo di trasmissione – obiettivo 1 msec.

Come vedremo, elementi caratterizzanti dei sistemi 5G sono (i) risorse spettrali specifiche, (ii) densificazione delle celle a radio frequenza e (iii) tecniche di network virtualisation / slicing (“softwarization”).

3. Spettro e compatibilità elettromagnetica (Emc) della tecnologia 5G

Riguardo alle (i) risorse spettrali, le frequenze impiegate nel 4G interessano i canali 800 MHz (“dividendo digitale” dal passaggio alla Tv digitale terrestre) ed altre bande Uhf (900, 1.800, 2.100 e 2.600 MHz), mentre il 5G utilizza sia frequenze Uhf (700 MHz, con necessità di “switch off” dalla TV alle comunicazioni elettroniche, come nel caso del passaggio al 4G–Lte) che le microonde (3,7 e 27 GHz), e in prospettiva le onde millimetriche -- oltre 30 GHz. L’assegnazione dei diritti d’uso (autunno 2018) – che ha portato 6.550.422.258 euro nelle casse dello Stato - ha riguardato infatti tre bande di frequenze:

- 694÷790 MHz (canali TV UHF 49-60, in corso switch-off del digitale terrestre), con ottima penetrazione degli ostacoli (mura, finestre, vegetazione, precipitazioni) ma velocità limitata a 30÷100 Mbps (a seguito della condivisione tra utenti simultanei nella cella)

- 3,6÷3,8 GHz (banda Fixed Wireless Access, Fwa), caratterizzata da maggiori velocità (100÷1.000 Mbps) ma penetrazione più limitata

- 26,5÷27,5 GHz (microonde), con portata molto limitata ma alte velocità (1÷10 Gbps).

Questo ci porta al punto (ii) densificazione delle celle a radio frequenza (RF). Le frequenze sempre più alte per poter avere velocità trasmissive maggiori implicano “footprint” (celle) più piccole e concentrate, con necessità di nuovi tralicci. Grazie alle ridotte dimensioni - ordine dei km nel caso dei 700 MHz, microcelle di centinaia di metri a 3,7 GHz e pico / femtocelle di decine metri a 27 GHz -, permettono un alto tasso di “riuso” delle frequenze in celle (vicine, vista la ridotta dimensione, ma) non adiacenti, una delle ragioni che permettono di fornire alte velocità a tutti gli utenti, anche in condizioni di alta densità -- fino a 1 milione di utenti / km2.

Le varie tipologie di celle e frequenze possono altresì essere combinate attraverso Distributed Antenna Systems (Das), capaci di meglio distribuire i segnali Rf in specifiche aree geografiche – tipicamente indoor -, dove c’è bisogno di ripetitori per diffondere il segnale che non arriverebbe efficacemente ove le condizioni di propagazione non fossero ottimali. Ad esempio, complessi sportivi, grattacieli, centri commerciali, stazioni ferroviarie, aeroporti, ospedali, ecc. I segnali potrebbero essere sia captati wireless in siti con buona copertura radio e rilanciati verso settori meno esposti alla radio frequenza, sia ricavati direttamente dalla rete fissa degli Operatori Telco -- ad es. femtocelle tramite rete Wi-Fi. Ciò consente sia di risolvere problemi di assenza o limitazione di copertura radio, che di fornire una maggiore capacità in aree con alta densità di utenti. Ad esempio, uno stadio, stazione o centro commerciale potrebbero essere attrezzati con un Das che aggiunge alla copertura cellulare esterna ulteriore capacità all’interno, mediante collegamento in fibra ottica alla rete fissa di un Operatore Telco.

Anche per introdurre a seguire il ragionamento sui rischi delle emissioni (compatibilità) elettromagnetiche, va ricordato che i nostri dispositivi adattano la loro potenza di trasmissione alla distanza dalla stazione radio base – più è lontana, maggiori sono la potenza emessa ed il consumo di batterie. Quindi, aumentare il numero di celle / antenne permette, oltre a maggiori tassi di riuso di frequenze e velocità di trasmissione, di diminuire le potenze di emissione – sia dei tralicci che dei nostri dispositivi, con impatti positivi sulla nostra salute.

Pertanto, con il 5G il numero di celle RF aumenterà, e non basterà aggiungere agli attuali siti apparati e antenne – Mimo (Multiple Input Multiple Output) con possibilità di beam forming, per poter “inseguire” il singolo utente e fornirgli potenze e capacità di banda senza disperderle altrove. Andranno incrementati i siti (sostanzialmente nei centri urbani e dorsali di trasporto, almeno in una prima fase), chiedendo nuovi permessi a proprietari e condomini ove prescelto.

Il fattore di incremento di densificazione varia in base alla popolazione, servizi richiesti, frequenze impiegate (Uhf, microonde / millimetriche), orografia / propagazione, cablatura in fibra ottica (stazioni radio base). È ipotizzabile più o meno un ordine di grandezza – celle da decine / centinaia di metri (o anche qualche km, nel caso dei 700 MHz) rispetto ai km del 4G. Potrebbe quindi risultare realisticamente proibitivo coprire tutto il territorio nazionale, da cui le probabili limitazioni iniziali ai centri urbani e dorsali di collegamento -- requisito formale per il 2025. Va ricordato che, per poter consegnare svariati Gbit/sec ad ogni singolo sito Rf (in modo che possa dispiegare le velocità citate ai singoli utenti della relativa cella) occorre fornire al sito collegamenti Ubb (e,g. fibra ottica), non agevole su tutto il territorio nazionale.

Inoltre, il proliferare di celle di piccola dimensione (50÷500 m) ad elevata frequenza, in grado di fornire capacità di decine o centinaia di Gbit/s, pone seri problemi regolamentari, quali favorire l’installazione di antenne e gestire limiti di esposizione / compatibilità elettromagnetica (EMC). Esiste infatti un grosso problema di uso restrittivo delle risorse da parte dei proprietari dei siti, problematiche di accesso ai siti pubblici a gestione privata (tunnel ferroviari, centri sportivi, shopping malls, etc.), cui viene fortunatamente in aiuto l’art. 57 della Direttiva Ue 2018/1972 (Codice europeo delle comunicazioni elettroniche, 11/12/2018) – “Installazione e funzionamento dei punti di accesso senza fili di portata limitata”.

Più delicata è la gestione dell’impatto EMC dovuto al proliferare di antenne, con tutti i problemi legati ai pericoli adombrati sulla salute, sostanzialmente a causa di errate informazioni / fake news sui limiti delle emissioni elettromagnetiche e gli effetti delle radiazioni non ionizzanti sulla salute. Occorre pazienza e capacità di convinzione basata su una comunicazione ben informata.

Al riguardo, i parametri e gli effetti delle emissioni elettromagnetiche sono studiati da Icnirp (International Commission on Non-Ionizing Radiation Protection), Ieee Ices (International Committee on Electromagnetic Safety), ecc. Gli effetti sanitari accertati sono sostanzialmente di natura termica, proporzionali all’energia Rf assorbita nel tempo (potenza) dai tessuti, e ai meccanismi fisiologici di dissipazione del calore. La grandezza fisica considerata (in relazione agli effetti) è lo Specific Absorption Rate (Sar), potenza assorbita per unità di peso (W/kg), normalmente proporzionale alla densità di potenza superficiale del campo elettromagnetico (W/m2) nel punto in cui si trova la persona esposta. I limiti sono tradizionalmente espressi in funzione del campo elettrico (V/m), proporzionale alla radice quadrata della potenza.

Tanto premesso per doverosa informazione scientifica, occorrerà sì aumentare il numero di antenne, ma la potenza dei segnali irradiati potrà essere inferiore per via delle ridotte dimensioni delle celle. Inoltre, rispetto alla soglia di potenza rilevata come potenzialmente pericolosa (livelli SAR dei casi accertati), i limiti internazionali ICNIRP sono 50 volte più bassi, e in Italia ancora 100 volte più bassi di questi (cioè cinquemila volte più bassi dei limiti ritenuti pericolosi). Per dare delle cifre, i noti (e criticati dagli Operatori come eccessivamente bassi) 6 V/m di campo elettrico (10 W/m2 densità di potenza) rispetto ai 61 V/m (0,1 W/m2) di quasi tutti i paesi UE.

Infine, come regola generale, più che le emissioni dei tralicci (molto attenuate quando raggiungono i nostri device), dovrebbero preoccuparci quelle dei nostri smartphone – emissioni a potenze basse (rispetto a quelle dei tralicci) ma molto vicine ai nostri organi vitali.

4. “Softwarizzazione” 5G

Relativamente a network virtualisation / slicing (“softwarization”) - punto (iii) del §2 -, è stato sottolineato nell’Introduzione come per aumentare la velocità delle applicazioni (throughput) e la qualità di esperienza (QoE) occorra non solo aumentare la velocità di trasmissione (bit rate), ma anche ridurre la latenza. Per fare ciò, occorre trovare il modo di ovviare alla intrinseca limitazione della velocità (della luce) alla quale si propagano i segnali – 300.000 km / sec nel vuoto e in condizioni ottimali. I ritardi di trasmissione non possono (neanche in linea teorica) essere quindi inferiori a diversi millisecondi se la distanza tra origine e destinazione è pari a centinaia o migliaia di km. Ciò è spesso inaccettabile per molti servizi “mission critical” – si pensi ad es. ad applicazioni di telechirurgia.

Si possono fornire servizi con tempi di latenza inferiori evitando di centralizzare le informazioni in data center in cloud a centinaia o migliaia di km, ma avvicinando questi server agli utenti, ponendoli ai bordi della rete (“edge cloud”). Sull’esempio delle content delivery network (Cdn) per i contenuti internet, le piattaforme di edge cloud (caching) agiscono in modo "intelligente", utilizzando funzionalità di self learning per selezionare i contenuti più richiesti, memorizzandoli e rendendoli disponibili in data center nelle vicinanze degli utenti finali. Ciò permette di ridurre sia la latenza che la quantità di traffico / packet loss sulla rete, che scambia i contenuti completi solo all’inizio delle sessioni, e poi solo il “delta” informativo tra un caricamento e il successivo.

Il cloud deve quindi “distribuirsi” ai bordi della rete, avvicinando il più possibile agli utenti finali (entro areole dell’ordine dei 50 km2 o anche meno) sia i contenuti che le funzioni di rete per l’esecuzione di software applicativi -- network function virtualization (Nfv), software-defined networking (Sdn), transparent content caching degli applicativi per migliorare la QoE, ecc. In tal modo, invece di pochi corposi data center di un grande cloud centralizzato, avremo tante piccole “nuvolette” sparse ai bordi della rete, che consentirà altresì di personalizzarle per servizi specifici.

Importanti funzioni della rete sono realizzate in software invece che in hardware dedicato come avviene oggi. La rete diventa in tal modo un insieme di programmi software, eseguibili e aggiornabili con molta flessibilità in cloud, nel quale la rete si integra pienamente, potendo usufruire in maniera efficiente di servizi solo all’occorrenza (Infrastructure, Platform, Software, … as a Service) e nella misura richiesta dai requisiti degli utilizzatori, sfruttando risorse comuni invece che sistemi localizzati presso gli utenti. Una tale “softwarizzazione” aggiunge una enorme flessibilità alla rete, e svolge un ruolo cruciale per ridurre i costi -- di installazione, aggiornamento, esercizio e manutenzione.

Ciò rende le reti 5G orientate ai servizi applicativi (disaccoppiati dai servizi di rete / connettività), dei quali possono supportare un'ampia varietà, con requisiti di servizio (SLR) anche molto differenti. È possibile realizzare varie reti logiche e/o virtuali indipendenti sulla stessa infrastruttura fisica, come se avessero ognuna una rete fisica dedicata. Si tratta di partizioni di rete flessibili e scalabili sulla stessa infrastruttura fisica ("fette"), agevolmente implementabili per via della citata softwarizzazione. Ogni "fetta" di rete è quindi a tutti gli effetti una rete completa – costituita da “slices” coerenti di tutti i componenti di rete - interfaccia radio, Radio Access Network (Ran), Core Network -, capace di soddisfare i requisiti di una specifica applicazione. Softwarizzazione e virtualizzazione sono caratteristiche distintive del 5G.

Le "fette" sono gestibili da Network Slicing Service Provider (Nssp) – e.g. Mobile Virtual Network Operator (Mvno) - che affittano dal gestore dell'infrastruttura 5G le risorse di rete necessarie, e realizzano le proprie network slices personalizzate, adattabili alle applicazioni richieste dai propri utenti. L’impiego di Intelligenza artificiale (Ai) stima e prevede dove sono richieste le risorse e le ottimizza -- dynamic resource allocation (Dra). In tal modo viene fornita una qualità di esperienza (QoE) Ai-assisted, sulla base dei requisiti di qualità del servizio desiderato (QoS). Al momento, AI è sostanzialmente un Supervised Machine Learning, mentre in prospettiva potrebbe includere un “apprendimento cognitivo” (Reinforcement Machine Learning). Sostanzialmente, anche attraverso modelli che utilizzano “gemelli” / repliche digitali (“digital twin”), si simulano dai dati in arrivo i possibili scenari, e si identificano nuove opzioni di assegnazione delle risorse in base ai vari scenari. NSSP multi-slice possono utilizzare correlazioni dalla raccolta di dati da slices differenti, e ottimizzare le risorse complessive delle reti e dei servizi forniti.

5. Possibili applicazioni 5G

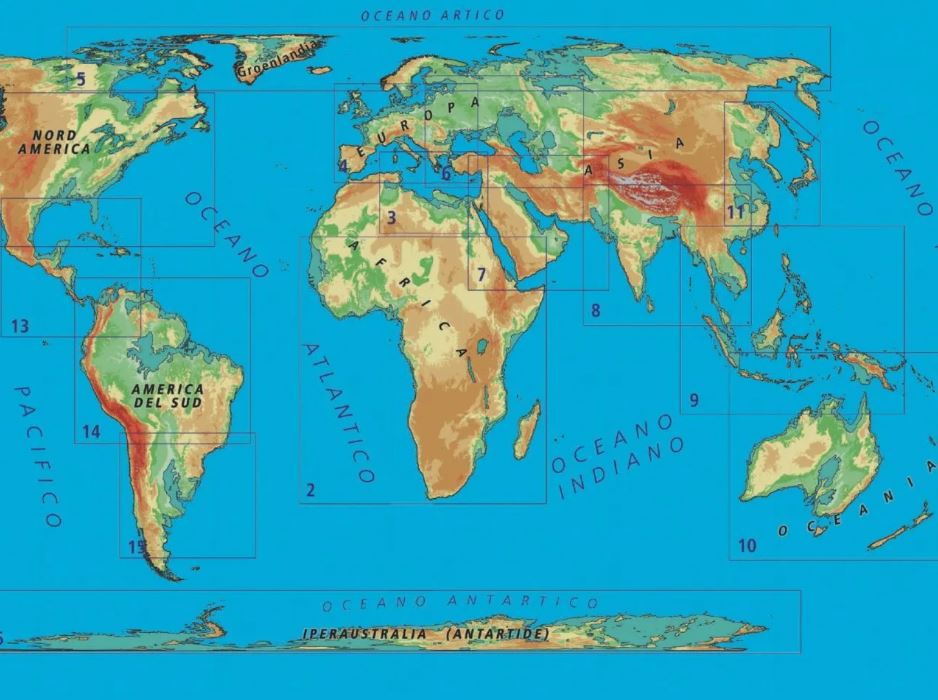

Per quanto sopra, il 5G è un abilitatore di nuovi servizi / applicazioni, che utilizza la convergenza fisso-mobile per ottimizzare tutta la rete (end-to-end orchestration), mediante servizi indipendenti dalla rete, celle RF di piccole dimensioni (alti riuso di frequenze / capacità), softwarization e bassa latenza (edge computing). L’”affettamento” della rete permette di gestire sulla stessa infrastruttura requisiti end-to-end di applicazioni diverse, sostanzialmente relativamente a (a) enhanced mobile broadband (eMbb), con elevati capacità di traffico e densità di utenti (fino a un milione / km2), (b) ultra-reliable & low latency communications (uRLLC) e (c) massive machine-type communications (mMTC), con moltissimi dispositivi a bassi costo / consumo e volume di dati -- sensoristica narrow band internet of things (nB / IoT). Si potrà così attivare un ecosistema aperto a nuovi player, startup, … -- V. “triangolo” Future IMT dell’International Telecommunication Union (ITU) in Fig.2.

La enhanced mobile broadband slice può supportare trasporti sicuri ad alta velocità di dati e bassa latenza, come ad esempio auto "parlanti" connesse tra loro (scambio dati ~25 GByte / ora), che possono interpretare in modo intelligente l'ambiente circostante e avvisare i conducenti (anche di altri veicoli) di potenziali pericoli e ridurre di incidenti. Ovvero entertainment, con app fruibili a banda ultralarga in posti anche molto affollati (alte velocità e latenze medie), ecc.

Possibili applicazioni della ultra-reliable low latency slice riguardano ad esempio la e-health - raccolta, gestione e condivisione di referti e dati sanitari, sensori di controllo e dispositivi medici, gestione urgenze / ricoveri (e.g. ambulanze connesse), telechirurgia (video ad altissima definizione e bassissima latenza), tele-monitoraggio, ecc. -.; controllo della produzione industriale; (video) monitoraggio remoto di smart grid, reti elettriche, idriche, gas, ecc.

La massive machine-type communications slice include ad es. le connected homes, con oggetti comunicanti tra loro a basse velocità e latenza, come termostati smart connessi a rilevatori di fumo, con i dati combinati trasmessi in real time ai vigili del fuoco in caso di incendio; ecc.

E ancora, utilizzando “fette” composite, Structural Health Monitoring (SHM), sistemi cyber-fisici (digita twin), soluzioni e applicazioni “mission critical” per la prevenzione e gestione di emergenze e calamità (Protezione Civile), Pubblica Sicurezza, metodi avanzati (realtà aumentata e virtuale, video ad alta definizione, AI, ecc.) per la formazione avanzata / blended learning, ecc.

In conclusione, a partire dall’aumento vertiginoso del traffico in rete, che richiede nuove reti a banda ultralarga, abbiamo esaminato nel presente articolo scenari e requisiti applicativi del 5G, illustrando il suo funzionamento end-to-end, lo spettro radio allocato, i timori per la salute dalle emissioni elettromagnetiche, le potenzialità della softwarization e le possibili applicazioni.

Il prossimo articolo illustrerà potenziali applicazioni future, sottolineandone l’interesse in ambito smart cities, i requisiti di sicurezza e net neutrality, le previsioni di mercato e diffusione del 5G, che saturerà realisticamente le sue capacità entro il 2030, dando vita alla prossima generazione 6G, già allo studio in Asia, Europa e Usa. Verranno illustrare le caratteristiche del 6G, le differenze evolutive rispetto al 5G e le iniziative in atto a livello internazionale.

«Non ho particolari talenti, sono solo appassionatamente curioso».

(Albert Einstein)

di Fulvio Ananasso, presidente dell’Associazione Stati Generali dell’Innovazione