La fine della privacy: come la sorveglianza di massa si sta diffondendo nel mondo

Algoritmi predittivi e droni per il riconoscimento biometrico rendono il controllo sempre più pervasivo e il dissenso più difficile. Tra occhiali “salva-identità” e vestiti con decorazioni “anti sorveglianza” c’è chi prova a rimanere anonimo.

Dalle strade della Nigeria ai checkpoint in Cisgiordania, passando per le città statunitensi, milioni di persone sono già osservate e identificate da sistemi automatizzati. La sorveglianza di massa non è più uno scenario futuristico, ma una realtà in rapida espansione alimentata dallo sviluppo dell’intelligenza artificiale e dalla crescente disponibilità di dati.

Undici Paesi africani, ad esempio, hanno investito oltre due miliardi di dollari in tecnologie cinesi capaci di riconoscere i volti e monitorare i movimenti delle persone. Solo la Nigeria ha speso oltre 470 milioni di dollari per installare 10mila telecamere; Egitto, Algeria e Uganda hanno acquistato migliaia di dispositivi simili. In molti di questi Paesi manca tuttavia una regolamentazione e un quadro giuridico in materia di archiviazione e utilizzo dei dati personali. Questi sistemi possono quindi essere utilizzati per controllare gli attivisti per i diritti umani e gli oppositori politici, arrestare i manifestanti e indurre i giornalisti all'autocensura. Ma ciò che sta accadendo in questi Paesi africani è solo una parte di un fenomeno globale che coinvolge, seppure con modalità diverse, regimi autoritari e democrazie consolidate.

Verso una sorveglianza predittiva?

Tra le tecnologie più diffuse c’è il riconoscimento facciale che consente di identificare una persona confrontando specifiche caratteristiche del volto, come la distanza tra gli occhi, la larghezza del naso e la forma del mento, con quelle archiviate in un database digitale. Altri sistemi riescono a identificare le persone in base alla loro corporatura, al colore e all’acconciatura dei capelli, ai vestiti e agli accessori indossati. E, come racconta il settimanale The Economist, la sorveglianza potrebbe presto estendersi anche ai cieli. Un team della Michigan State University sta lavorando a FarSight, un drone in grado di effettuare un “riconoscimento biometrico di tutto il corpo”: a partire dall’analisi dell’andatura di una persona, un algoritmo può ricostruirne l’anatomia e generare un profilo utilizzabile per future identificazioni.

Parallelamente si sta affermando anche la cosiddetta predictive policing, o sorveglianza predittiva. Basata sull’analisi di grandi quantità di dati e sull’intelligenza artificiale, questa tecnologia punta ad anticipare potenziali attività criminali prima che si verifichino, individuando luoghi e persone coinvolte. Uno sviluppo tecnologico che ricorda inevitabilmente il film Minory report, in cui la polizia riesce a impedire i crimini prima che vengano compiuti grazie alle premonizioni di tre persone, chiamate Precog. Come osserva The Conversation, si tratta di un mercato in continua crescita che, secondo alcune stime, raggiungerà un valore di circa 157 miliardi di dollari entro il 2034 (nel 2024 era pari a 3,4 miliardi di dollari).

Nonostante venga spesso presentata come uno strumento per rafforzare la sicurezza pubblica, l’uso della sorveglianza predittiva solleva preoccupazioni per la violazione della privacy e per la mancanza di trasparenza su come i modelli vengono sviluppati, addestrati o monitorati per verificarne l’accuratezza e l’eventuale presenza di pregiudizi.

Queste tecnologie, infatti, non sono infallibili: gli errori possono essere causati da una scarsa qualità delle immagini o da bias legati all’etnia, al genere e all’età. Gli esempi non mancano: all'inizio di quest'anno la polizia ha arrestato un uomo nel Regno Unito per un furto con scasso in una città che non aveva mai visitato; lo scorso ottobre un sistema di intelligenza artificiale ha scambiato la busta di Doritos di uno studente di una scuola superiore di Baltimora per un'arma da fuoco e ha chiamato la polizia locale; una donna del Tennessee ha passato oltre cinque mesi in carcere dopo essere stata erroneamente collegata a un’indagine per frode bancaria nel Nord Dakota.

Repressione 4.0: l’esempio della Cina e dell’Iran

Nei Paesi in cui non è consentito nessun tipo di dissenso, i sistemi di videosorveglianza e di riconoscimento facciale possono essere uno strumento per aumentare il controllo e la repressione. In questo ambito, la Cina rappresenta il caso più evidente. “Lo Stato monitora i suoi 1,4 miliardi di abitanti attraverso una vasta rete di telecamere, controlli su internet e l'obbligo di utilizzare la carta d'identità nazionale per acquistare qualsiasi cosa, dalle schede Sim ai biglietti per spettacoli di cabaret” osserva il New York Times. È un controllo destinato a diventare ancora più pervasivo dopo la recente approvazione del “Piano d’azione AI+”, un progetto che pone l’intelligenza artificiale al centro di ogni ambito della vita, dall’istruzione alla sanità. I gruppi per i diritti umani denunciano, inoltre, l’utilizzo di queste nuove tecnologie per monitorare le minoranze, ad esempio in Tibet o nello Xinjiang, o gli attivisti a Hong Kong.

In Iran la tecnologia per monitorare i dispositivi mobili, le app e il traffico web è stata integrata con una rete di sistemi di riconoscimento facciale. Da una recente inchiesta condotta da Forbidden stories, in partnership con alcune testate internazionali tra cui Le Monde, è emerso come il sistema iraniano non sia solo in grado di riconoscere il volto e tracciare i movimenti di una persona, ma riesca anche a creare una “mappa sociale” delle sue relazioni e amicizie. Queste tecnologie, acquistate da aziende cinesi e russe, sono state centrali nella repressione delle proteste che hanno attraversato il Paese tra dicembre 2025 e gennaio 2026, consentendo alle autorità di arrestare e interrogare persone sospettate di aver partecipato alle manifestazioni.

In nome della sicurezza: i casi di Stati Uniti e Israele

Da anni negli Stati Uniti le tecnologie di riconoscimento facciale sono impiegate soprattutto da forze di polizia e da agenzie federali per attività di sicurezza pubblica: le immagini raccolte dalle telecamere sparse per le città vengono incrociate con quelle presenti nei database o sui social media per identificare persone scomparse o sospettate di un crimine. Più recentemente gli agenti dell’Ice (Immigration and custmos enforcement) hanno iniziato a utilizzare l’applicazione Mobile Fortify nelle operazioni contro l’immigrazione irregolare per tracciare le persone senza documenti e identificare le cittadine e i cittadini che protestano contro le attività dell’agenzia.

In Israele i sistemi di riconoscimento facciale sono utilizzati da anni nei territori palestinesi occupati per monitorare in modo continuo la popolazione e limitarne movimenti, una pratica che Amnesty International ha definito “automated apartheid”. Ai checkpoint nelle città della Cisgiordania, ad esempio, i palestinesi vengono identificati da telecamere ad alta risoluzione prima di poter ricevere l’autorizzazione a passare, mentre i soldati sono dotati di un’applicazione per scansionare i loro volti e aggiungerli a un database, senza il loro consenso.

Tentativi di regolamentazione: l’Ai Act dell’Unione europea

Con l’Ai act, entrato in vigore a febbraio 2025, l’Unione europea ha vietato il riconoscimento in tempo reale, cioè quello che identifica una persona mentre cammina per strada, con eccezioni molto limitate per le forze dell'ordine in caso di minacce di attacchi terroristici, di ricerca delle vittime e di indagine che riguardano reati gravi. L’Ai Act, inoltre, vieta i sistemi di riconoscimento biometrico che utilizzano dati sensibili, come le idee politiche o la religione, e la possibilità di creare database per il riconoscimento facciale con immagini ottenute da internet.

In Italia, il decreto Milleproroghe ha esteso fino al 31 dicembre 2027 la moratoria sull’installazione e sull’utilizzo di sistemi di riconoscimento facciale nei luoghi pubblici o aperti al pubblico. Il provvedimento riguarda l’identificazione biometrica a posteriori, ovvero l’analisi di video già registrati. I soggetti privati, come i proprietari di un negozio, non potranno installare sistemi di videosorveglianza basati sul riconoscimento biometrico nei luoghi accessibili al pubblico; le autorità competenti, invece, potranno utilizzarle a fini di prevenzione e repressione dei reati o di esecuzione di sanzioni penali, solo in presenza del parere favorevole del Garante per la protezione dei dati e della privacy.

Sfuggire alla sorveglianza

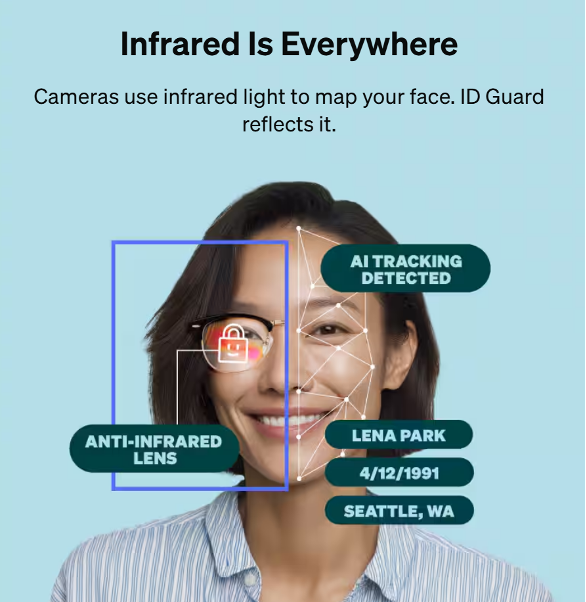

C’è chi sta sperimentando metodi per confondere i sistemi di sorveglianza: l’azienda statunitense Zenni, ad esempio, ha introdotto un modello di occhiali, chiamato ID Guard, che “offre fino all'80% in più di protezione dai raggi infrarossi rispetto alle lenti standard, contribuendo a interrompere il riconoscimento facciale indesiderato”.

Altre aziende, come il marchio italiano Cap_able, creano capi di abbigliamento con motivi decorativi progettati per ingannare gli algoritmi (adversarial pattern): in alcuni casi sono stati prodotti vestiti con molti volti iperrealistici stampati per impedire alle telecamere di capire dove si trova il volto che dovrebbero riconoscere; in altri casi le fantasie ricordano i mantelli di animali come zebre o leopardi. E sta nascendo un nuovo stile di trucco e acconciatura per “mimetizzarsi”, chiamato cv dazzle (cv è la sigla di computer vision, mentre dazzle significa mimetizzarsi): parrucche colorate che nascondono parzialmente gli occhi o make-up applicati solo su metà del viso rendono più difficile il riconoscimento facciale.

“Per ora, in gran parte del mondo, truccarsi in modo creativo, indossare cappelli larghi o occhiali riflettenti, coprirsi parte del volto o deviarne l’immagine con una lente distorcente non è vietato. Ma non è detto che sarà sempre così” scrive il giornalista Alberto Puliafito in un articolo pubblicato su Internazionale. L’efficacia di queste contromisure però è limitata: funzionano in contesti specifici e contro tecnologie meno avanzate, mentre i sistemi più sofisticati continuano a evolversi, riducendo progressivamente la possibilità di rimanere “invisibili”.