Il problema con Elon Musk e con il lungotermismo

Cos'è il lungotermismo e quali sono le sue implicazioni per il futuro? E qual è il ruolo di Musk in questa "setta millenarista"? Un'analisi a partire dal libro di Fabio Chiusi, "L’uomo che vuole risolvere il futuro".

di Roberto Paura, tratto da "Quaderni d'altri tempi"

Abbiamo un problema con Elon Musk. E no, non è esattamente quello che pensate. Non è semplicemente il problema che l’uomo oggi più ricco del mondo, titano della tecnologia, proprietario di un influente social network, è anche una persona piena di strane e pericolose idee sulla politica, l’umanità e il suo futuro; è piuttosto il problema di come quelle idee stiano infettando il discorso sul futuro al punto da rischiare di farlo deragliare fino a chiudere la porta a ogni possibilità di pensare il futuro.

Mr. Musk, risolvo problemi

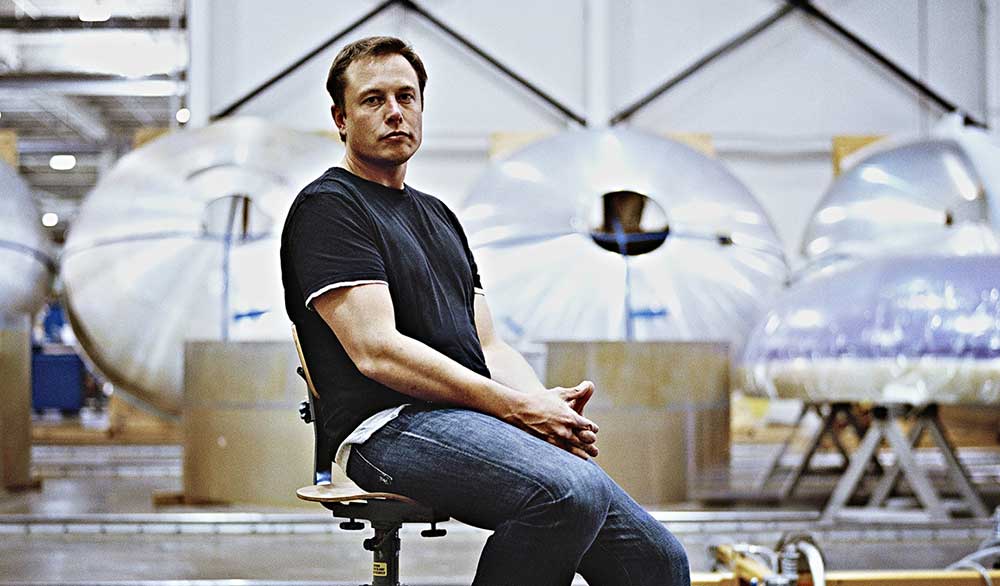

Quando uscì la prima biografia di Elon Musk, scritta dal giornalista Ashlee Vance (Elon Musk: Tesla, SpaceX e la sfida per un futuro fantastico) era il 2015 e il magnate di origini sudafricane era ancora noto solo tra i tecno-entusiasti appassionati di spazio e auto elettriche. Per far capire chi fosse bisognava spiegare che Musk era stato il co-fondatore di PayPal prima di vendere tutto per dedicarsi alla creazione di una società spaziale con il pallino di andare su Marte. Quella di Vance non era un’agiografia, e al di là della grande fascinazione per il tecnocrate si intravedevano già i tratti di una personalità a dir poco singolare (il calcolo del tempo necessario a trovare una nuova partner, sottratto al lavoro) e le sue convinzioni stravaganti (“La cosa importante sul lungo termine è stabilire una base autosostenibile su Marte”).

All’epoca, tuttavia, Musk rappresentava un piacevole diversivo dai classici Ceo di Big Tech che stavano facendo i soldi con i social network e gli smartphone anziché dedicarsi ai veri problemi del mondo (“Le migliori menti della mia generazione stanno pensando a come fare in modo che le persone clicchino sui banner pubblicitari”, come sintetizzò con celebre efficacia un ex ingegnere di Facebook). Tra i successori di Steve Jobs per i quali il futuro era la nuova versione dell’iPhone da presentare in cerimonie in grado di far impallidire la notte degli Oscar e il volto inquietante di Mark Zuckerberg che faceva miliardi vendendo dati personali al miglior offerente si inseriva quest’uomo con la faccia del tipico nerd bullizzato alle scuole (qual era stato in effetti) che prometteva di costruire batterie efficienti per l’energia solare, auto a impatto zero e con guida automatica, razzi in grado di atterrare da soli per poter essere riutilizzati rendendo l’accesso allo spazio un obiettivo a portata di chiunque. Un uomo per il quale il futuro non era una app per acchiappare Pokemon ma rispecchiava le visioni di quanti erano cresciuti a pane e fantascienza. Musk parlava di come creare intelligenze artificiali in grado di risolvere tutti i problemi dell’umanità, di treni ad aria compressa in grado di sfiorare le velocità degli aerei di linea, di colonie su Marte. Come non appassionarsi della sua visione del futuro?

Negli ultimi anni, questo mito si è fortemente incrinato. Durante la pandemia Musk, anziché impegnarsi negli sforzi di contenere il virus, ha iniziato a diffondere teorie complottiste contro i lockdown. Già prima era emerso il suo ambiguo sostegno alle politiche di Trump, e ben presto ha iniziato a emergere il discorso tipicamente alt-right contro i cosiddetti woke, dipinti come troppo impegnati a guardarsi l’ombelico pensando a quali pronomi usare per definire la loro identità di genere piuttosto che darsi da fare per cambiare il mondo. La guerra di Musk a Twitter, il suo social network preferito, reo di imporre il pensiero unico del politicamente corretto contro il cinismo muskiano, lo ha portato alla più tradizionale delle sparate di un arci-miliardario: se qualcosa non mi piace, la compro e la cambio.

È iniziata così a prendere forma la consapevolezza che a Elon Musk non sta tanto a cuore il futuro, quanto la sua visione del futuro, da imporre a tutti i costi. Prima attraverso i soldi, poi attraverso la tecnologia, quindi attraverso la grancassa dei social network; e magari, in un giorno non troppo lontano, attraverso la politica attiva. Una visione del futuro che Fabio Chiusi, nel suo L’uomo che vuole risolvere il futuro, ascrive correttamente alla categoria del “soluzionismo tecnologico” (Morozov, 2014):

“Solo mettere gli ingegneri e gli scienziati al comando, suggerisce questa scuola di pensiero applicata alla comprensione di Musk, ci darà una reale possibilità di risolvere il futuro, trattarlo cioè, da buoni soluzionisti, come un altro dei problemi umani riducibili a calcolo, probabilità e assiomi matematici”.

Le questioni politiche finiscono così per essere derubricate a ostacolo del progresso, secondo una visione che si richiama a quella di Ayn Rand, la filosofa dell’ultraliberismo i cui testi sono un mantra nella Silicon Valley, e che sognava una secessione degli innovatori e degli imprenditori dal governo federale americano. Musk si è rivelato così non essere molto diverso dagli altri guru di Big Tech, ugualmente impegnato nella crociata che vede nel progresso tecnologico l’unica cosa che conta e nelle questioni sociali o ambientali solo un inutile ostacolo.

Il lungotermista

Ma, come si diceva, non è tanto questo il problema. Se lo fosse, non sarebbe nuovo: Musk non sarebbe altro che l’ennesimo capitano d’industria sfornato dall’ideologia californiana (Barbrook e Cameron, 1996), da Jeff Bezos a Larry Page e Sergey Brin fino a Mark Zuckerberg. Il libro di Fabio Chiusi ci aiuta a capire invece qual è la differenza tra Musk e tutti gli altri. Questa differenza ha il nome di un’ideologia di cui si è iniziato a parlare un paio di anni fa: longtermism, in italiano lungotermismo (Chiusi usa la variante ibrida “longtermismo”). L’idea di partenza è che l’esistenza delle generazioni a venire conti tanto quanto quella delle persone che vivono oggi sulla Terra e che pertanto l’obiettivo morale fondamentale dell’essere umano dev’essere quello di garantire la sopravvivenza del “potenziale umano” sul lungo termine. La conseguenza è che la priorità di una qualsiasi agenda politica dovrebbe andare nella direzione di salvaguardare la sopravvivenza della nostra specie attraverso la mitigazione dei cosiddetti “rischi esistenziali”, quei rischi cioè che potrebbero condurre al collasso della civiltà tecnologica o addirittura all’estinzione del genere umano.

Il corollario più problematico di questa ideologia, ben espresso nel controverso testo di William MacAskill What We Owe the Future (2022), manifesto del lungotermismo, è che tra la mitigazione di un rischio in grado di annientare il 99% degli esseri umani e uno che può annientarne il 100%, sarà sempre il secondo a dover avere la precedenza. Ne consegue una singolare scala di priorità, nella quale per esempio il cambiamento climatico si situa più in basso dell’impatto di un asteroide, perché il primo non sembra essere in grado di portare la nostra specie all’estinzione, il secondo sì, benché il primo sia enormemente più probabile del secondo. In realtà queste conclusioni non sono così nette. MacAskill nel suo libro parla diffusamente dei vantaggi della decarbonizzazione per il futuro della civiltà, e Toby Ord nel suo The Precipice (2020), altro testo indicato come base della filosofia lungotermista, fa dei calcoli probabilistici per cui mentre l’impatto di livello estintivo con un corpo celeste nel corso di questo secolo è dato a uno su 150 milioni, un rischio esistenziale prodotto dal cambiamento climatico è dato a uno su mille. Tuttavia, Ord ritiene che il più grande rischio per la nostra specie in questo secolo sia dato dall’emergere di una unaligned artificial intelligence, un’intelligenza artificiale non allineata ai valori umani (probabilità: uno su dieci).

Elon Musk è tra i principali sostenitori di questa convinzione. Già in tempi non sospetti metteva in guardia dai rischi della “superintelligenza”, termine coniato dal suo filosofo di riferimento, Nick Bostrom (2018), teorico a sua volta del concetto di “rischio esistenziale” (Bostrom, 2002). Nel frattempo dava vita a OpenAi proprio con l’obiettivo di favorire una ricerca aperta e open source sulle Ai cosiddette “generali” – in grado cioè di imitare l’intelligenza umana generalista e non specializzata – e foraggiava con decine di milioni i centri di ricerca nati con il fine di mitigare i rischi della superintelligenza, tra cui il Future of life institute. Cosa c’è di sbagliato in tutto questo? Lo spiega bene Fabio Chiusi:

“Così Musk può dichiararsi a favore di regole per l’intelligenza artificiale – unica eccezione alla sua ideologia politica, fondamentalmente libertaria – e insieme risultare assente dal dibattito sulla seminale normativa europea in materia, ignorare le battaglie della società civile contro gli abusi e le discriminazioni algoritmiche e la sorveglianza biometrica, e dedicarsi piuttosto principalmente a vaghe petizioni di principio morali, come quelle contenute negli «Asilomar Principles» – a loro volta, imbevuti di longtermismo – che Musk ha contribuito a stendere”.

Non c’è alcun dubbio che per Musk sia più importante rendere la specie umana multiplanetaria attraverso la colonizzazione di Marte (al fine di avere un “pianeta di riserva” se qualcosa andasse storto su questo) che sostenere gli sforzi alla transizione ecologica dei governi di mezzo mondo, esattamente sulla base dell’ideologia lungotermista. Più in profondità, questa ideologia si rifà a una corrente della filosofia morale detta “altruismo efficace” che sembra molto in voga tra i miliardari tecno-soluzionisti, il cui obiettivo – sintetizza Chiusi – consiste nell’“applicare la ragione e l’approccio scientifico alla filantropia, nel nome del dettame – utilitarista, ça va sans dire – di produrre la massima quantità di bene per unità di denaro donata”. E in ottica lungotermista ha più senso investire per andare su Marte e salvaguardare i diritti dei miliardi di esseri umani che così potranno nascere in futuro piuttosto che investire nel contrasto ai cambiamenti climatici.

Sul lungo termine siamo tutti morti?

Il lungotermismo è stato descritto come una “setta millenarista” (Signorelli, 2023), nonché come “il credo secolare più pericoloso del mondo” (Torres, 2021). Musk, in quanto suo interprete, diventa di conseguenza il guru di una pericolosa psicosetta non per via delle sue idee sul presente – la critica al politicamente corretto, la concezione ultralibertaria dell’economia, il disprezzo per le regole – ma della sua visione del futuro. Qui si situa il grande problema di fondo. C’è modo e modo di parlare di “lungo termine”. Per esempio, tra i riferimenti ideologici di Musk discussi da Chiusi nel suo libro ci sono romanzi di fantascienza come il ciclo della Fondazione di Isaac Asimov e quello della Cultura di Iain Banks, che mettono in scena futuri di lunghissimo termine della civiltà umana.

Ma l’idea asimoviana di preservare le conoscenze dell’umanità dalla barbarie successiva alla caduta dell’Impero galattico attraverso l’istituzione di una fondazione scientifica che ha per (apparente) scopo quella di redigere una Enciclopedia Galattica, pur avendo avuto un’influenza determinante sul lungotermismo (Chiusi ci ricorda la Lifeboat foundation, che ha convinto Musk a mandare in orbita una copia del libro di Asimov), non è poi da buttar via. Così come non lo è il futuro post-scarsità immaginato da Banks dove l’intelligenza artificiale è messa al servizio di un’umanità finalmente libera dai bisogni materiali. Asimov e Banks, d’altronde, erano progressisti di sinistra che inorridirebbero di fronte alle sparate di Musk. La loro attenzione al lungo termine si situa in una corrente di pensiero che è alternativa a quella che invece ha foraggiato un altro grande pezzo del credo muskiano, che fa riferimento alle concezioni ultralibersiste del transumanesimo (Hans Moravec, Ray Kurzweil, Max More). Né si può dire che preoccuparsi delle generazioni future sia di per sé un errore. Il tema della giustizia transgenerazionale è oggi al centro del dibattito etico e ha spinto persino l’Italia a dotarsi di una modifica costituzionale a tutela dell’“interesse delle future generazioni”.

Il vero problema con Musk sta nel rischio che ogni discorso sul “lungo termine” finisca per essere additato come espressione della “setta lungotermista” del musk-pensiero e di buttar via il bambino con l’acqua sporca. Per esempio Now for the Long Term fu il titolo di un manifesto adottato nel 2013 dalla Oxford Martin commission for future generations dell’Università di Oxford, presieduta dall’ex direttore del Wto Pascal Lamy e che includeva tra i suoi membri il premio Nobel Amartya Sen e l’ex presidente del Cile Michelle Bachelet. La loro chiamata alle armi per riformare le istituzioni mondiali al fine di renderle più orientate alle sfide di lungo termine e al benessere delle generazioni a venire dovrebbe essere tacciata di estremismo lungotermista?

Eppure la Oxford Martin school è lo stesso terreno di coltura da cui è nato il Future of humanity institute diretto da Nick Bostrom, l’ideologo di riferimento del lungotermismo, e di cui fa parte Toby Ord. Il Center for existential risk dell’Università di Cambridge è stato fondato da Lord Martin Rees, ex presidente della Royal Society, il cui sforzo per istituire una commissione parlamentare sulle generazioni future al Parlamento inglese va di pari passo con un’accanita attività divulgativa sull’importanza del pensiero di lungo termine. Nel suo libro Il nostro futuro (2019) Rees si occupa tanto di intelligenza artificiale e postumanesimo quanto di Antropocene e, pur essendo uno scienziato, non condivide affatto il positivismo ingenuo di Elon Musk, dato che da tempo si occupa di mettere in guardia dai limiti della ricerca scientifica e dai rischi di uno sviluppo tecnologico non regolamentato (Rees, 2004, 2012). Che dire poi di una questione che rappresenta una delle più recenti fissazioni di Musk, quella del declino demografico, definito in una dichiarazione dello scorso anno “di gran lunga il principale pericolo che minaccia la civiltà umana”? Chiusi ne individua le motivazioni usando il filtro ideologico del lungotermismo:

“Sommando infatti il longtermismo e il pronatalismo incarnati da Musk diventa naturale pensare che anche un embrione sia da considerare un non-ancora-nato del cui «potenziale» vada garantita piena espressione. Se ogni essere umano non è che un serbatoio di valore per l’umanità nel suo complesso, allora il passaggio a posizioni ideologicamente anti-abortiste è breve.”

Ma questo non vuol dire che la fissazione dei lungotermisti per il declino demografico non abbia basi fondate. La civiltà umana non è affatto preparata a un simile futuro, molto più imminente di quanto generalmente si pensi (cfr. Bricker e Ibbitson, 2020), e mentre l’opinione pubblica generalmente saluta con favore una simile prospettiva ritenendola una buona notizia per il pianeta, si ignora il fatto che la correlazione tra aumento del reddito e calo del tasso di natalità nasconde anche una correlazione tra aumento del reddito e impronta ecologica, con il rischio di avere meno persone sulla Terra ma con consumi tali da accelerare anziché rallentare la devastazione ambientale. Se è vero che per un lungotermista come Bostrom la questione è piuttosto quanti miliardi di miliardi di persone potrebbero non vivere tra un miliardo di anni se non facciamo figli oggi (cfr. Bostrom, 2003), la distrazione globale nei confronti della denatalità (e del conseguente invecchiamento della popolazione) dà l’idea di quale sia il problema opposto: il presentismo. Fino a poco tempo fa considerato il grande male dell’epoca moderna, oggi il presentismo sembra assumere persino un’accezione positiva quando i critici del lungotermismo lo utilizzano in chiave ideologica, affermando cioè che l’enfasi sul presentismo sia una fissazione di miliardari eccentrici e tecno-soluzionisti che vogliono distrarci dai problemi del presente.

Certo, la superintelligenza artificiale non è dietro l’angolo e forse non ci sarà mai, ma prendere in considerazione i rischi dell’Ai futura è necessariamente un male, se non va a scapito dei problemi del presente? Preoccuparsi di un asteroide che potrebbe finirci addosso, per quanto improbabile possa sembrare, è per forza una stravaganza? E non erano queste le stesse considerazioni che hanno derubricato ad allarmismo i tentativi di Bill Gates (e di molti altri) di prevenire una pandemia virale, o gli sforzi del Club di Roma di metterci in guardia già all’inizio degli anni Settanta dalle conseguenze di una crescita economica infinita sulla biosfera? Il problema dunque non è tanto Elon Musk, ma il fatto di lasciargli campo libero nel definire il discorso sul futuro a lungo termine. La conseguenza sarà chiuderci sempre più nel presente, lasciando liberi i tecno-soluzionisti di progettare i loro futuri a misura di maschi bianchi, ricchi e occidentali, mentre a noi non resteranno alternative praticabili al presente esteso in cui siamo immersi.

fonte dell'articolo e delle immagini: Quaderni d'altri tempi